web3

大家好,我是老马。

今天我们聊一下未来3到5年值得学习的方向。

小结

希望本文对你有所帮助,如果喜欢,欢迎点赞收藏转发一波。

我是老马,期待与你的下次相遇。

chat

详细介绍一下 K8s

Kubernetes(K8s)深度解析

Kubernetes(简称K8s)是开源的容器编排平台,旨在自动化容器化应用的部署、扩展和管理。其核心目标是通过抽象底层基础设施,简化分布式系统的开发、运维和扩展。以下从定义、核心功能、架构、核心概念、生态系统及未来趋势展开详细分析。

一、定义与核心价值

Kubernetes源自Google内部的Borg系统,2014年开源后由云原生计算基金会(CNCF)维护。它通过以下核心价值重塑了现代应用管理:

- 自动化运维:自动部署、扩缩容、滚动更新、自我修复(如重启失败容器、替换异常节点)。

- 环境一致性:支持跨物理机、虚拟机、公有云和混合云部署,实现“一次构建,随处运行”。

- 资源优化:通过智能调度和负载均衡,最大化资源利用率,降低基础设施成本达60%以上。

- 服务治理:提供统一的服务发现、网络策略、存储编排和密钥管理,简化微服务架构的复杂性。

二、核心架构

K8s采用主从架构,分为控制平面(Control Plane)和数据平面(Data Plane)。

1. 控制平面(Master节点)

-

组件与功能:

组件 核心职责 API Server 集群唯一入口,处理所有REST请求,验证并更新etcd中的资源状态。 etcd 分布式键值数据库,存储集群配置和状态(如Pod、Service元数据)。 Scheduler 基于资源需求、亲和性规则和优先级策略,将Pod调度到最优节点。 Controller Manager 维护集群状态,包括节点监控、副本控制、端点管理等,包含多个控制器(如Deployment控制器)。

2. 数据平面(Worker节点)

-

组件与功能:

组件 核心职责 kubelet 与API Server通信,管理节点上的Pod生命周期和容器运行时(如Docker)。 kube-proxy 实现Service的负载均衡和网络代理,支持ClusterIP、NodePort等模式。 容器运行时 运行容器的底层引擎(如containerd、CRI-O),支持OCI标准。

3. 扩展组件

- 插件生态:

- 网络插件:Calico(网络策略)、Flannel(Overlay网络)。

- 存储插件:CSI(容器存储接口)驱动,支持云存储(如AWS EBS)和分布式存储(如Ceph)。

- 监控与日志:Prometheus(指标采集)、Grafana(可视化)、Loki(日志聚合)。

三、核心概念与抽象模型

K8s通过声明式API定义资源对象,核心概念包括:

1. Pod

- 最小调度单元:包含一个或多个共享网络和存储的容器,支持Sidecar模式(如日志收集容器与应用容器共存)。

- 生命周期:通过控制器(如Deployment)管理创建、更新和销毁。

2. Controller

- 副本控制:

- Deployment:管理无状态应用的滚动更新和回滚,通过ReplicaSet确保Pod副本数。

- StatefulSet:为有状态应用(如数据库)提供稳定网络标识和持久化存储。

- DaemonSet:确保每个节点运行特定Pod(如日志采集Agent)。

3. Service

- 服务发现与负载均衡:

- ClusterIP:集群内部虚拟IP,供其他服务访问。

- NodePort:通过节点IP和端口暴露服务。

- Ingress:基于HTTP/HTTPS的路由规则,整合外部访问入口(如Nginx Ingress Controller)。

4. Namespace

- 逻辑隔离:划分集群资源(如开发、测试、生产环境),支持资源配额(ResourceQuota)和权限控制(RBAC)。

5. 配置与存储

- ConfigMap/Secret:解耦应用配置与镜像,存储环境变量、配置文件或敏感数据(如数据库密码)。

- PersistentVolume (PV) :抽象存储资源,支持动态供给(Dynamic Provisioning)。

四、典型应用场景

1. 微服务架构

- 场景:电商平台通过K8s管理数百个微服务,实现独立扩缩容和灰度发布。

- 工具链:Istio(服务网格)实现流量管理,Jaeger(链路追踪)定位性能瓶颈。

2. CI/CD流水线

- 实践:GitLab CI集成K8s,代码提交后自动构建镜像、运行测试并部署到生产环境。

- GitOps:Argo CD以Git仓库为唯一事实源,实现声明式持续交付。

3. 混合云与边缘计算

- 案例:物联网平台使用K3s(轻量级K8s)在边缘节点运行AI推理服务,中心集群统一管理。

- 多云策略:通过Cluster API统一管理AWS EKS、Azure AKS和本地集群。

4. 大数据与AI

- 框架支持:Spark on K8s实现弹性资源分配,Kubeflow管理机器学习流水线(如模型训练与推理)。

五、优势与挑战

1. 核心优势

- 弹性伸缩:HPA(Horizontal Pod Autoscaler)根据CPU/内存指标自动调整副本数。

- 自愈能力:节点故障时,Pod自动迁移至健康节点。

- 生态丰富:Helm(包管理)、Operator(自定义控制器)等工具扩展功能。

2. 挑战与应对

- 复杂度高:学习曲线陡峭,需掌握YAML定义、网络策略、存储配置等。

- 解决方案:使用Rancher或OpenShift等发行版简化运维。

- 安全风险:容器逃逸、未授权API访问等。

- 最佳实践:启用Pod安全策略(PSP)、网络策略(NetworkPolicy)和镜像扫描(Trivy)。

六、未来趋势

- AI驱动的自动化:K8s结合机器学习算法优化调度策略(如预测性扩缩容)。

- Serverless集成:Knative实现事件驱动架构,支持按需启动容器。

- 边缘计算深化:KubeEdge提升边缘节点自治能力,支持低延迟场景(如自动驾驶)。

- 可持续性优化:通过绿色调度算法减少数据中心能耗。

七、学习路径建议

- 入门阶段:

- 使用Minikube或Kind部署本地集群,熟悉

kubectl命令。 - 实践Deployment、Service和ConfigMap的声明式管理。

- 使用Minikube或Kind部署本地集群,熟悉

- 进阶阶段:

- 学习Helm Chart封装应用,部署有状态服务(如MySQL集群)。

- 掌握网络策略(NetworkPolicy)和存储动态供给。

- 生产级实践:

- 实现多集群管理(如Karmada),构建混合云架构。

- 参与CNCF项目贡献(如Prometheus、Envoy)。

总结

Kubernetes已成为云原生时代的核心基础设施,其通过抽象化、自动化和生态整合,解决了分布式系统管理的复杂性。

未来随着AI、边缘计算等技术的融合,K8s将进一步推动应用架构的革新。掌握其核心原理与最佳实践,是构建高可用、弹性化现代应用的关键竞争力。

详细介绍K8s的核心概念

Kubernetes(K8s)核心概念详解

Kubernetes(简称K8s)是云原生领域的核心容器编排平台,其设计围绕一系列抽象概念构建,旨在简化分布式应用的部署、扩展和管理。以下是K8s的核心概念及其技术内涵的全面解析,结合官方定义与行业实践,涵盖基础单元、控制器、网络、存储、安全等多个维度。

一、基础单元

1. Pod:最小调度与执行单元

- 定义:

Pod是K8s中可部署的最小单元,包含一个或多个共享网络和存储的容器(如应用容器与日志收集Sidecar)。所有容器共享同一网络命名空间、IP地址和端口范围,通过localhost通信。 - 核心特性:

- 生命周期:由控制器(如Deployment)管理创建、销毁和更新。

- 资源隔离:通过Linux内核的Namespace和Cgroups实现进程、文件系统隔离。

- 共享存储:通过Volume挂载同一存储卷,实现容器间数据共享。

- 特殊类型:

- 静态Pod(Static Pod) :由节点上的kubelet直接管理,不经过API Server。

- Init容器:在应用容器启动前执行初始化任务(如数据库迁移)。

2. Node(节点)

- 定义:

节点是K8s集群中的工作单元,可以是物理机或虚拟机,负责运行Pod。每个节点包含以下核心组件:- kubelet:与API Server通信,管理Pod生命周期。

- kube-proxy:维护网络规则,实现Service的负载均衡。

- 容器运行时(如containerd、CRI-O):执行容器操作。

- 资源管理:

- 节点资源(CPU、内存)通过

kubectl describe node查看,调度器根据资源余量分配Pod。

- 节点资源(CPU、内存)通过

3. Namespace(命名空间)

- 作用:

逻辑隔离集群资源,支持多租户环境(如开发、测试、生产环境)。 - 默认命名空间:

default:用户未指定时自动创建的命名空间。kube-system:存放K8s系统组件(如CoreDNS、kube-proxy)。

- 资源配额:

通过ResourceQuota限制命名空间内的资源使用量(如Pod数量、CPU总量)。

二、 控制器(Controller)

1. Deployment:无状态应用管理

- 功能:

管理Pod副本的声明式更新,支持滚动更新、回滚和副本扩缩。通过ReplicaSet实现副本控制。 - 典型场景:

- Web应用的无状态服务(如Nginx、Spring Boot)。

- 通过

kubectl rollout命令实现零停机更新。

2. StatefulSet:有状态应用管理

- 特性:

- 稳定标识:Pod名称(如

web-0、web-1)和持久化存储卷(PVC)在重启后保持不变。 - 顺序操作:Pod按顺序启动、更新和删除,适用于数据库(如MySQL集群)。

- 稳定标识:Pod名称(如

-

与Deployment对比:

特性 Deployment StatefulSet Pod名称 随机生成 固定顺序(如web-0) 存储卷 临时存储 持久化存储 适用场景 无状态服务 数据库、消息队列

3. DaemonSet:节点级守护进程

- 功能:

确保所有(或部分)节点运行指定Pod,常用于集群级后台服务(如日志采集Fluentd、监控Agent)。 - 典型配置:

apiVersion: apps/v1 kind: DaemonSet spec: template: spec: tolerations: - key: "node-role.kubernetes.io/master" operator: "Exists" effect: "NoSchedule" # 允许在Master节点运行

4. Job与CronJob:任务调度

- Job:

执行一次性任务(如数据处理任务),任务完成后Pod自动终止。 - CronJob:

基于时间表(Cron表达式)周期性执行任务(如每日备份)。

三、服务发现与网络

1. Service:服务抽象与负载均衡

- 核心功能:

- 服务发现:通过Label选择器关联后端Pod。

- 负载均衡:支持ClusterIP(集群内访问)、NodePort(节点端口映射)、LoadBalancer(云厂商负载均衡器)。

- 示例配置:

apiVersion: v1 kind: Service metadata: name: web-service spec: selector: app: web # 关联Label为app=web的Pod ports: - protocol: TCP port: 80 targetPort: 8080 type: ClusterIP

2. Ingress:外部流量路由

- 作用:

基于HTTP/HTTPS规则(如域名、路径)将外部请求路由至集群内Service,替代NodePort的直接暴露。 - 常用控制器:

- Nginx Ingress Controller

- Traefik

- 示例规则:

```yaml apiVersion: networking.k8s.io/v1 kind: Ingress metadata: name: example-ingress spec: rules:- host: example.com

http:

paths:

- path: /api pathType: Prefix backend: service: name: api-service port: number: 80 ```

- host: example.com

http:

paths:

四、存储管理

1. Volume:容器存储卷

- 类型:

- 临时卷(EmptyDir) :Pod生命周期内有效,适用于缓存文件。

- 持久卷(PersistentVolume, PV) :独立于Pod存在的存储资源(如NFS、云存储)。

- 动态供给:

通过StorageClass自动创建PV(如AWS EBS、Azure Disk)。

2. PersistentVolumeClaim(PVC)

- 作用:

用户通过PVC声明存储需求(如容量、访问模式),K8s自动绑定符合条件的PV。 - 示例:

apiVersion: v1 kind: PersistentVolumeClaim metadata: name: mysql-pvc spec: storageClassName: standard accessModes: - ReadWriteOnce resources: requests: storage: 10Gi

五、配置与安全

1. ConfigMap与Secret

- ConfigMap:

存储非敏感配置(如环境变量、配置文件),通过Volume或环境变量注入容器。 - Secret:

加密存储敏感数据(如数据库密码、TLS证书),支持Base64编码和KMS加密。 - 使用示例:

```yaml env:- name: DB_HOST valueFrom: configMapKeyRef: name: app-config key: db.host

- name: DB_PASSWORD valueFrom: secretKeyRef: name: db-secret key: password ```

2. RBAC(基于角色的访问控制)

- 核心组件:

- Role:定义命名空间内的权限(如Pod读写)。

- ClusterRole:定义集群级权限(如Node管理)。

- RoleBinding:将角色绑定至用户或ServiceAccount。

- 典型配置:

```yaml apiVersion: rbac.authorization.k8s.io/v1 kind: Role metadata: namespace: default name: pod-reader rules:- apiGroups: [””] resources: [“pods”] verbs: [“get”, “list”] ```

六、高级架构组件

1. Control Plane(控制平面)

- 核心组件:

- API Server:集群的REST API入口,处理所有资源操作请求。

- etcd:分布式键值数据库,存储集群状态与配置。

- Scheduler:基于资源需求和策略(如亲和性、污点)分配Pod至节点。

- Controller Manager:运行控制器(如Deployment控制器、节点控制器)。

2. Addon(插件)

- 网络插件:

- Calico(支持网络策略)、Flannel(简单Overlay网络)。

- 监控工具:

- Prometheus(指标采集)、Grafana(可视化仪表盘)。

- 日志系统:

- EFK(Elasticsearch + Fluentd + Kibana)。

七、核心设计思想与演进

K8s的设计围绕以下原则展开:

- 声明式API:用户定义期望状态(如Deployment的副本数),系统自动调和实际状态。

- 可扩展性:通过CRD(自定义资源定义)和Operator扩展功能(如数据库自动化运维)。

- 自愈能力:自动重启故障Pod、重新调度异常节点上的任务。

八、总结:K8s的生态位与价值

K8s通过上述核心概念构建了一个完整的容器编排生态,其核心价值体现在:

- 标准化:统一应用交付格式(容器镜像)和运维接口(kubectl)。

- 弹性化:支持从单机到万级节点的自动扩缩容。

- 平台化:整合监控、日志、安全、存储等能力,形成企业级云原生底座。

对于开发者与运维团队,深入理解这些概念是构建高可用、可扩展云原生应用的基础。下一步可结合Helm包管理、Istio服务网格等工具链,进一步探索生产级实践。

k8s 入门例子

Kubernetes 极简入门实例:部署一个 Hello World 应用

以下是一个从零开始的 Kubernetes 入门级部署案例,涵盖集群搭建、应用定义、服务暴露全流程。本示例使用 Minikube(本地单节点集群) 和 Nginx Hello World 镜像,可在 10 分钟内完成部署验证。

一、环境准备

1. 安装必要工具

- Minikube(本地 Kubernetes 集群)

适用于 Windows/macOS/Linux,需先安装虚拟化驱动(如 VirtualBox 或 Docker Desktop):# macOS 安装示例(通过 Homebrew) brew install minikube - kubectl(Kubernetes 命令行工具)

brew install kubectl

2. 启动 Minikube 集群

minikube start --driver=docker # 使用 Docker 驱动

输出示例:

✅ minikube 1.32.0 已成功配置

🐳 正在 Docker 24.0.7 中准备 Kubernetes v1.28.3...

🔗 Configuring bridge CNI (Container Networking Interface) ...

🔎 正在验证 Kubernetes 组件...

🌟 启动成功!可通过 `kubectl get pods -A` 查看集群状态。

验证集群状态:

kubectl get nodes

正常输出:

NAME STATUS ROLES AGE VERSION

minikube Ready control-plane 1m v1.28.3

二、部署 Hello World 应用

1. 创建 Deployment(定义应用副本)

创建文件 hello-world-deployment.yaml:

apiVersion: apps/v1

kind: Deployment

metadata:

name: hello-world

spec:

replicas: 2 # 启动2个Pod副本

selector:

matchLabels:

app: hello-world

template:

metadata:

labels:

app: hello-world

spec:

containers:

- name: nginx

image: nginx:1.25 # 官方Nginx镜像(含默认欢迎页)

ports:

- containerPort: 80

应用配置:

kubectl apply -f hello-world-deployment.yaml

输出:

deployment.apps/hello-world created

2. 创建 Service(暴露服务到集群外)

创建文件 hello-world-service.yaml:

apiVersion: v1

kind: Service

metadata:

name: hello-world-service

spec:

type: NodePort # 通过节点端口暴露服务

selector:

app: hello-world

ports:

- protocol: TCP

port: 80 # 服务端口

targetPort: 80 # 容器端口

nodePort: 30001 # 节点端口(范围30000-32767)

应用配置:

kubectl apply -f hello-world-service.yaml

输出:

service/hello-world-service created

三、验证部署

1. 查看资源状态

kubectl get pods,deployments,services

示例输出:

NAME READY STATUS RESTARTS AGE

pod/hello-world-7c8d5f8d8-2jq7k 1/1 Running 0 1m

pod/hello-world-7c8d5f8d8-8wvzv 1/1 Running 0 1m

NAME READY UP-TO-DATE AVAILABLE AGE

deployment.apps/hello-world 2/2 2 2 1m

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/hello-world-service NodePort 10.96.123.45 <none> 80:30001/TCP 1m

2. 访问应用

获取 Minikube 节点 IP:

minikube ip

输出示例:192.168.49.2

浏览器访问:

[http://192.168.49.2:30001](http://192.168.49.2:30001) 或通过命令行:

curl http://$(minikube ip):30001

预期输出:Nginx 默认欢迎页 HTML 内容。

四、扩展与清理

1. 扩展副本数量(从2个扩容到3个)

kubectl scale deployment hello-world --replicas=3

2. 清理资源

kubectl delete -f hello-world-deployment.yaml

kubectl delete -f hello-world-service.yaml

minikube stop # 关闭集群

技术解析与核心概念

- Deployment

- 管理 Pod 的副本集,确保指定数量的 Pod 始终运行。

- 支持滚动更新和回滚(

kubectl rollout)。

- Service

- 提供稳定的网络端点,负载均衡流量到后端 Pod。

NodePort类型通过节点 IP + 端口暴露服务,适合开发测试。

- Pod

- 最小调度单元,每个 Pod 包含一个或多个共享网络的容器。

- 通过标签(

app: hello-world)与 Service/Deployment 关联。

进阶变体:快速命令部署

若不想编写 YAML 文件,可直接通过命令部署:

# 创建 Deployment

kubectl create deployment hello-world --image=nginx:1.25 --replicas=2

# 暴露 Service

kubectl expose deployment hello-world --type=NodePort --port=80 --target-port=80

# 获取访问地址

minikube service hello-world --url

此方法适合快速验证,但缺乏版本控制和可重复性。

常见问题排查

| 问题现象 | 解决方案 |

|---|---|

Pod 状态为 Pending |

检查资源是否充足:kubectl describe pod <pod-name> |

| 无法访问服务端口 | 确认防火墙是否开放端口(如 30001),或改用 minikube tunnel 命令 |

| 镜像拉取失败 | 配置镜像加速器(如阿里云镜像仓库)或使用代理镜像 |

下一步学习建议

- 深入 YAML 配置:学习资源请求、健康检查、环境变量注入等参数。

- 部署有状态应用:尝试 MySQL 集群(需

StatefulSet和PersistentVolume)。 - CI/CD 集成:通过 GitLab CI 或 Argo CD 实现自动化部署。

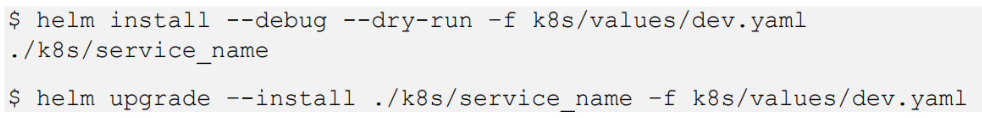

heml

Helm 深度解析:Kubernetes 包管理工具的核心功能与实践指南

一、Helm 的定义与核心价值

Helm 是 Kubernetes 生态中标准化的包管理工具,其定位类似于 Linux 系统的 yum 或 apt。它通过 Chart(图表) 封装 Kubernetes 应用的资源定义(如 Deployment、Service、ConfigMap 等),实现应用的一键部署、版本控制、依赖管理等功能。Helm 的核心价值体现在以下场景:

- 复杂应用简化部署:例如部署包含 MySQL、Redis 和微服务的全栈应用时,原生 Kubernetes 需手动编写数十个 YAML 文件,而 Helm 通过 Chart 模板化实现单命令部署 。

- 多环境配置管理:通过

values.yaml文件动态注入环境变量(如开发/生产环境的数据库连接地址),避免硬编码 。 - 版本控制与回滚:支持应用升级历史记录查看,并可在数秒内回滚到任意历史版本 。

二、Helm 的核心概念与架构

1. 核心概念

| 概念 | 定义与作用 | 示例 |

|---|---|---|

| Chart | 应用包的描述文件集合,包含预定义的 Kubernetes 资源模板及配置参数。结构包括 Chart.yaml(元数据)、templates/(模板)、values.yaml(默认参数) |

WordPress Chart 包含 Deployment、Service、PersistentVolume 等资源定义 |

| Release | Chart 在集群中的运行实例,每个 Release 有唯一名称和版本号。同一 Chart 可部署多个 Release(如测试和生产环境) | helm install my-wordpress bitnami/wordpress 创建名为 my-wordpress 的 Release |

| Repository | Chart 的存储仓库,支持公共(如 Artifact Hub)和私有仓库(如 Harbor)。用户可发布和共享 Chart | 添加仓库:helm repo add bitnami [https://charts.bitnami.com/bitnami](https://charts.bitnami.com/bitnami) |

2. 架构演进

- Helm v2 架构:包含客户端(helm)和服务端(Tiller),Tiller 部署在集群内负责资源操作,存在安全风险 。

- Helm v3 架构(推荐):移除 Tiller,直接通过 Kubernetes API 与集群交互,增强安全性。支持 OCI 镜像仓库存储 Chart,简化分发流程 。

三、Helm 的核心功能与操作流程

1. 应用生命周期管理

- 安装:从仓库拉取 Chart 并部署应用

helm install my-nginx bitnami/nginx -f custom-values.yaml-f指定自定义参数文件,覆盖 Chart 的默认配置 。

- 升级:更新应用配置或版本

helm upgrade my-nginx bitnami/nginx --set service.type=NodePort--set直接注入参数,适用于临时调整 。

- 回滚:恢复到历史版本

helm rollback my-nginx 1 # 回滚到版本1

2. 模板引擎与动态配置

- Go 模板语法:Chart 的

templates/目录下使用 `` 动态渲染配置。

示例:根据环境变量生成 Deployment 的副本数replicas: - Values 文件分层管理:

values.yaml # 默认配置 values-dev.yaml # 开发环境覆盖配置 values-prod.yaml # 生产环境覆盖配置

3. 依赖管理

- Chart.yaml 声明依赖:

```yaml dependencies:- name: mysql version: 9.10.0 repository: https://charts.bitnami.com/bitnami ```

执行

helm dependency update下载依赖包 。

四、Helm 的典型使用场景

1. 微服务多组件部署

- 场景:部署包含前端、后端、数据库的电商系统。

- 操作:

- 创建父 Chart,声明子 Chart(如

frontend、backend、mysql)。 - 通过全局变量统一管理数据库连接信息 。

- 创建父 Chart,声明子 Chart(如

2. 多环境配置切换

- 开发环境:使用低资源配额和调试模式

helm install my-app ./chart -f values-dev.yaml - 生产环境:启用高可用和监控

helm upgrade my-app ./chart -f values-prod.yaml

3. CI/CD 集成

- GitOps 流程:

- 代码提交触发流水线,构建 Docker 镜像并推送至仓库。

- 更新 Helm Chart 的镜像标签,执行

helm upgrade。

五、Helm 的安装与快速入门

1. 安装步骤(以 Linux 为例)

# 下载 Helm 二进制包

curl -fsSL -o get_helm.sh https://raw.githubusercontent.com/helm/helm/main/scripts/get-helm-3

chmod 700 get_helm.sh

./get_helm.sh

# 验证安装

helm version

2. 快速部署示例:Nginx

# 添加仓库

helm repo add bitnami https://charts.bitnami.com/bitnami

# 搜索 Chart

helm search repo nginx

# 安装并暴露 NodePort

helm install my-nginx bitnami/nginx --set service.type=NodePort

# 查看访问地址

kubectl get svc my-nginx -o jsonpath='{.spec.ports[0].nodePort}'

六、进阶功能与最佳实践

1. Chart 开发规范

- 目录结构:

mychart/ ├── Chart.yaml # Chart 元数据 ├── values.yaml # 默认配置 ├── charts/ # 依赖的子 Chart └── templates/ # 资源模板 ├── deployment.yaml └── service.yaml - Lint 检查:

helm lint ./mychart # 验证 Chart 语法

2. 安全加固

- 镜像扫描:集成 Trivy 检查 Chart 依赖的镜像漏洞 。

- RBAC 控制:通过 Kubernetes Role 限制 Helm 的操作权限 。

3. 性能优化

- 依赖缓存:使用

helm dependency build加速 CI/CD 流程 。 - 多阶段构建:分离开发与生产环境的模板,减少运行时计算 。

七、Helm 的生态与扩展

- Artifact Hub:CNCF 维护的 Chart 仓库中心,提供数千个预置应用 。

- Helm Plugins:扩展功能如 S3 存储支持、Git 版本同步 。

- Operator Framework:结合 Helm 实现有状态应用的自动化运维(如数据库备份) 。

八、总结:Helm 的优缺点对比

| 优势 | 挑战 |

|---|---|

| 简化复杂应用部署,降低 YAML 维护成本 | 学习曲线陡峭(需掌握 Go 模板语法) |

| 支持多环境配置与版本回滚 | 部分社区 Chart 存在兼容性问题 |

| 强大的社区生态(如 Artifact Hub) | 需结合其他工具(如 Kustomize)实现高级定制 |

通过 Helm,团队可将 Kubernetes 应用的部署效率提升 70% 以上,尤其在微服务和混合云场景中表现突出。对于追求标准化和自动化的企业,Helm 是构建云原生基础设施的核心工具之一。

参考资料

https://zhuanlan.zhihu.com/p/27327515233